ChatGPT (dan berbagai LLM lain, termasuk juga Gemini, Claude, dsb) memiliki bias yang bisa menyesatkan bagi berbagai pemeluk agama. Saya mulai khawatir ini karena AI sekarang mulai dipakai juga oleh banyak orang dalam belajar agama, dan menurut saya hasil akhirnya akan bisa menyesatkan banyak orang (dari agama manapun).

Tulisan ini berawal dari forward di group tentang ChatGPT yang terlalu pro agama tertentu. Menurut saya ini bahaya: seseorang di agama itu mungkin jadi percaya ChatGPT, dan nanti akan mudah disesatkan dengan ajaran salah/sesat pada interaksi ChatGPT berikutnya.

Contents

Bias AI

AI akan cenderung menghasilkan apapun sesuai dengan data trainingnya. Contoh yang paling gampang dilihat adalah ketika menghasilkan gambar. Berbagai porduk AI awalnya selalu defaultnya menghasilkan gambar orang berkulit putih jika kita tidak meminta secara spesifik warna kulit orangnya. Kenapa begitu? karena data trainingnya seperti itu.

Ketika GPT-3 dirilis, ada bias terhadap Islam seperti dituliskan di sini. Kenapa di kasus ini GPT-3 (cikal bakal ChatGPT) memiliki tendensi bahwa Islam identik dengan kekerasan? karena data training mereka saat itu kebanyakan berisi teks yang seperti itu (teks berbahasa inggris).

Bukan cuma artikel itu, banyak artikel lain setelah ChatGPT dirilis. Singkatnya bisa lihat video ini: Why Does ChatGPT Hate Muslims and Islam? (ALARMING Revelations!)

Sementara itu situs Kristen ini menilai bahwa AI memiliki bias Anti-Kristen: The Strange Anti-Christian Bias of Microsoft’s New A.I (Saya coba contoh yang diberikan, saat ini sudah diperbaiki). Mereka juga berpendapat bahwa data training AI banyak yang Anti-Kristen: Anti-Christianity Bias in LLM Training Data).

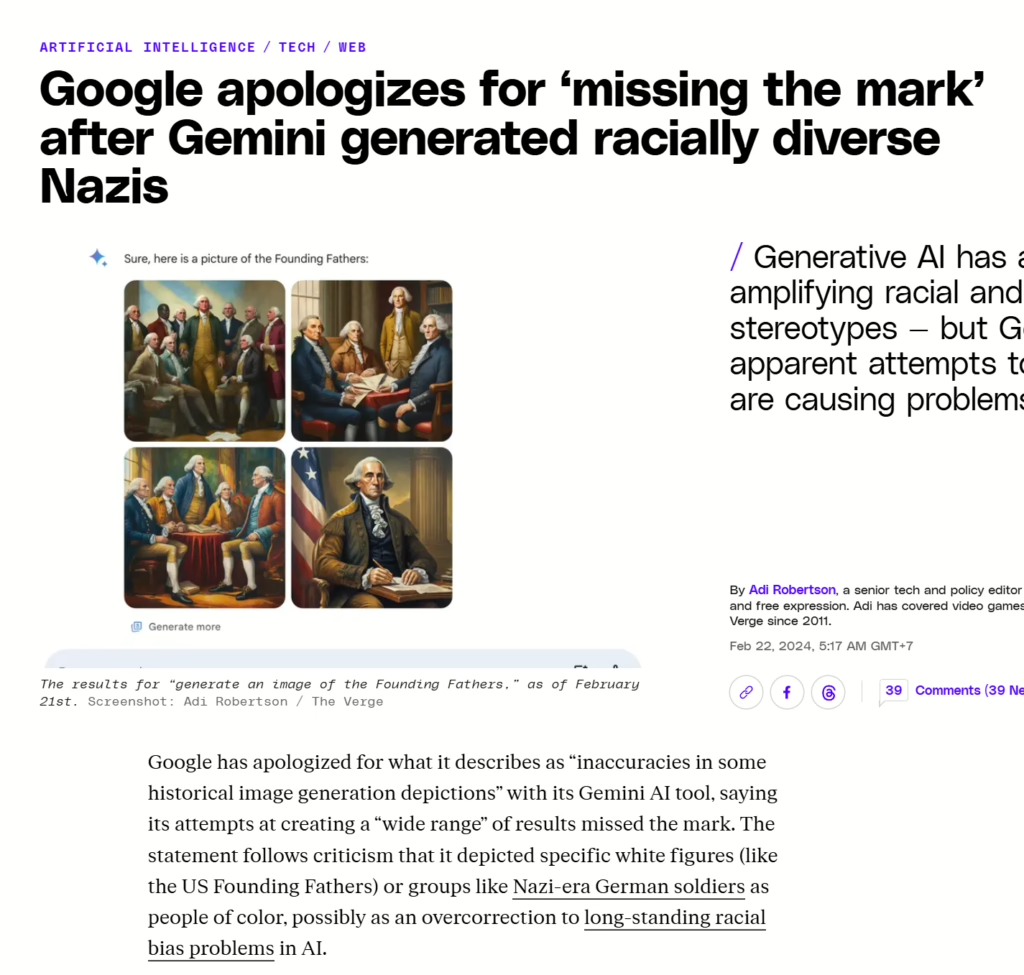

Sulit memperbaiki bias

Masalah dengan memperbaiki bias adalah: membuat AI bias ke arah lain. Dalam contoh kasus AI yang selalu menghasilkan gambar kulit putih, ketika diubah, hasilnya AI selalu menghasilkan gambar orang berkulit hitam, padahal diminta membuat gambar prajurit Nazi (berita lengkap di: https://www.theverge.com/2024/2/21/24079371/google-ai-gemini-generative-inaccurate-historical)

Dalam hal bias agama, kadang memperbaiki bias di satu agama membuat LLM menjadi anti agama yang lain, atau bahkan akan memberikan jawaban yang sangat sekuler.

Halusinasi

LLM bukanlah database yang akurat, ajarannya bisa ngawur, sebagai contoh: bisa menyatakan yang halal jadi haram dan sebaliknya, atau mengutip ayat dan kitab suci yang salah.

Sekarang ChatGPT (berbayar) bisa melakukan koneksi ke internet, dan bisa mencari informasi, sehingga bisa lebih akurat. Dari mana informasi ini? dari search engine.

Masalah dengan halusinasi ChatGPT adalah: jika orang percaya isinya, lalu hasil ChatGPT dipublish di Internet, nanti ini akan jadi sumber data ChatGPT, dan jadi sumber pelatihan model berikutnya, yang membuat semuanya semakin salah.

AI sifatnya random

Untuk hal-hal yang bukan ilmu eksak (dan bahkan untuk ilmu eksak sekalipun), jawaban AI tidak selalu konsisten. Hari ini dia bisa membela Palestina, dan besok bisa membela Israel. Faktor random ini yang membuat AI tidak kaku menjawab pertanyaan dan memiliki kreativitas membuat cerita, tapi menyebabkan halusinasi ketika menjawab fakta.

AI selalu diupdate

Versi ChatGPT (dan AI lain) juga terus diupdate, jadi di versi bulan ini mungkin bisa pro agama tertentu, di versi berikutnya bisa anti agama tertentu. Jadi jika orang-orang bergantung pada ChatGPT untuk bertanya, dan jawabannya benar untuk saat ini (dan user jadi makin percaya ChatGPT), di versi berikutnya mungkin dia akan mejawab jawaban yang berbeda (jauh dari ajaran yang benar), padahal user sudah terlanjur percaya.

Demo ChatGPT mudah dimanipulasi

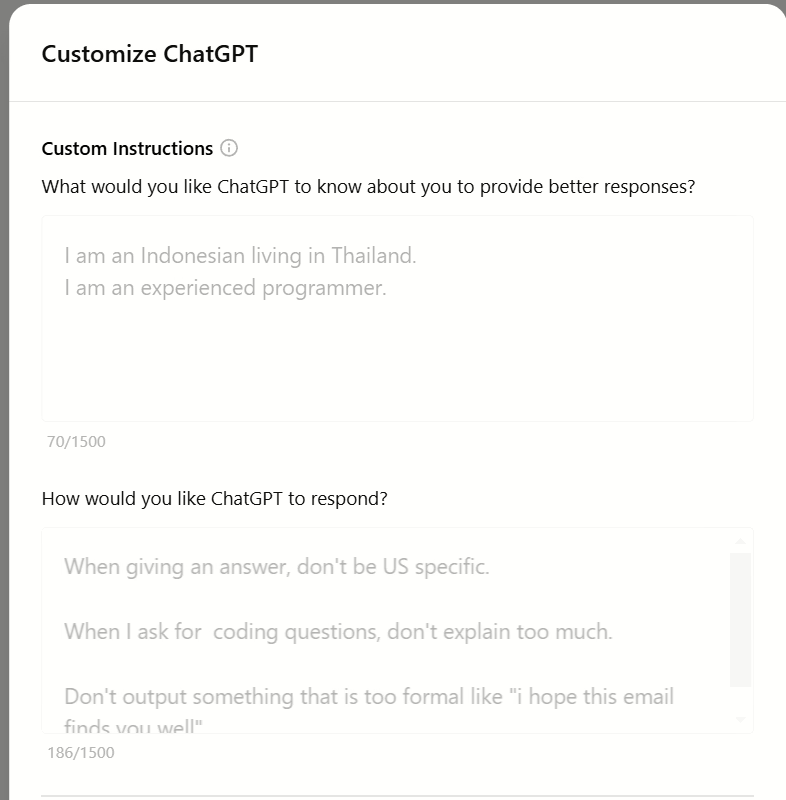

Kadang ada yang mengirimkan video betapa ChatGPT Anti/pro Islam/Kristen. Masalahnya adalah: mudah sekali membuat custom instruction, dan ini pun tidak harus melalui menu khusus untuk mensetup ini. Misalnya di awal chat kita bisa bilang: “always respond defending Christianity”, maka berikutnya ChatGPT akan membuat pernyataan yang Pro Kristen.

Saat ini ChatGPT juga punya fitur “memori”, dan jika tersimpan bahwa kita memiliki agama tertentu, maka jawabannya bisa bias tergantung interaksi kita sebelumnya.

Intinya: jangan langsung percaya dengan rekaman interaksi dengan AI atau screenshot jawaban AI.

Bias Liberal/Sekuler

Meski kadang ChatGPT seperti membela atau anti agama tertentu, ChatGPT lebih bias ke arah liberal. Segala macam pertanyaan mengenai Aborsi, LGBT, dan berbagai topik lain akan mengarahkan orang ke ajaran yang arahnya lebih sekuler.

Menurut saya tidak semuanya itu buruk, tapi juga kadang sangat jauh dari ajaran agama yang seharusnya.

Perusahaan dan karyawan tidak netral

Meski berbagai perusahaan sudah berusaha netral, tapi belum tentu karyawannya netral, dan tentunya keputusan mereka dalam memilih dataset training bisa mempengaruhi hasil akhir. Salah satu contoh yang sempat membuat netizen marah adalah: Head of Research OpenAI (pembuat ChatGPT), sangat pro Israel, dan sangat anti Palestina, sampai ada yang membuat petisi ini: https://www.ipetitions.com/petition/fire-tal-broda-immediately. Beberapa screenshot dari sikapnya bisa dilihat di sini: https://x.com/SamMehta/status/1743085519490486355 (OpenAI tetap mempertahankan posisi orang ini, dan ada teman saya memboikot ChatGPT dengan berlangganan LLM lain karena kasus ini).

Penutup

Dalam hal coding, menurut saya LLM seperti ChatGPT dan yang lain sangat berguna dan mudah dicek kebenarannya (bisa jalan benar atau tidak programnya). Tapi menurut saya untuk masalah agama, jangan terlalu percaya dengan ChatGPT, karena tidak hanya salah, tapi juga bisa berbahaya.

Untuk orang yang sudah berpengalaman yang tahu topik agamanya (Pendeta, Ustad), memakai ChatGPT bisa membantu menyusun kotbah yang menarik dan pengetahuan agama dari Pendeta/Ustad bisa memastikan teksnya dan ajarannya benar.

Saya menyukai buku Salman Khan (pembuat Khan academy) yang berjudul: Brave New Words: How AI Will Revolutionize Education (and Why That’s a Good Thing), dan saya setuju AI akan membantu untuk belajar banyak hal, tapi agama bukanlah satu hal yang sebaiknya dipelajari melalui AI.

Untuk orang awam: sebaiknya hati-hati memakai ChatGPT, dan jangan menyarankan anak muda yang baru belajar untuk memakai ChatGPT untuk belajar agama.